Ei DEV: Tua app tá pronta pra conversar com LLMs?

Alessandro Feitoza

- Fortaleza, Ceará

- Professor de códigos e outras computarias ( ͡° ͜ʖ ͡°)

- Programador/Dev/Severino

- PHP com Rapadura | PHPeste

- TechLead/Dev BússolaSocial

Agenda

- Arquitetura

- Performance

- Consumo de Tokens

- E o padrão TOON

Parece simples…

Frontend → Backend → API LLM → Resposta

Se é só um POST… por que a conta explode?

const response = await fetch("/api/llm", {

method: "POST",

body: JSON.stringify({

system: "Você é um analista financeiro.",

context: dados,

question: "pergunta"

})

})

O que realmente vai na requisição

- System prompt

- Instruções

- Contexto adicional

- Histórico da conversa

- Pergunta atual

Nada disso é grátis.

Token ≠ Palavra

- Token é pedaço de palavra

- Pontuação vira token

- Aspas viram token

- Estrutura vira token

O problema do JSON

{

"user": "AlessandroFeitoza",

"message": "Explique orientação a objetos"

}

Aspas. Chaves. Vírgulas. Indentação.

Tudo vira token.

Performance não é só latência

- 💰 Custo financeiro (tokens)

- ⏱ Processamento maior

- 🧠 Contexto poluído reduz precisão

Se o prompt é pesado, a LLm fica lenta

Erro clássico

Tratar LLM como API REST comum

return response()->json([

"status" => "success",

"data" => [

"title" => "...",

"description" => "...",

"confidence" => 0.98

]

]);

Você está pagando por sintaxe.

JSON é pra

humano ver

{

"name": "Chiquim",

"phones": [

"85 9 8888-9999",

"85 9 9797-1234"

]

}

{"name": "Chiquim", "phones": ["85 9 8888-9999", "85 9 9797-1234"]}

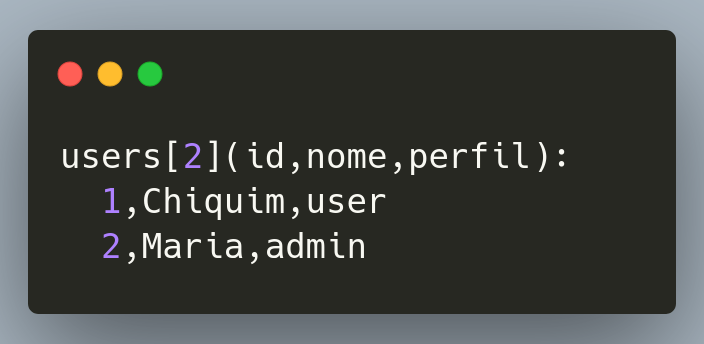

TOON

Text-Oriented Object Notation

- Estrutura mínima

- Sem ruído sintático

- Linear

- Foco em semântica

JSON vs TOON

JSON

{

"title": "OO",

"summary": "Paradigma...",

"keywords": ["classe","objeto"]

}

TOON

title: OO

summary: Paradigma...

keywords: classe | objeto

Menos tokens. Mesma informação.

Arquitetura recomendada

Controller

↓

Prompt Builder

↓

Context Optimizer

↓

LLM Client

↓

TOON Parser

- Separação de responsabilidades

- Redução de contexto desnecessário

- Parsing simples

No fim

- IA é linguagem

- Linguagem é token

- Token é custo

- Custo é arquitetura